Derrière chaque application web performante, chaque plateforme cloud fiable, se cache une technologie souvent méconnue mais essentielle : le reverse proxy.

Parmi les solutions disponibles, Nginx s'est imposé comme la référence mondiale, alimentant près de 40 % des sites internet les plus visités.

Mais qu'est-ce qu'un reverse proxy exactement ? Pourquoi Nginx domine-t-il ce marché ?

Et surtout, quel rôle joue cette technologie dans les infrastructures cloud de confiance ?

Qu'est-ce qu'un reverse proxy ?

C’est un serveur qui se positionne entre les utilisateurs (clients) et les serveurs web qui hébergent les applications. Contrairement à un proxy classique qui aide les utilisateurs à accéder à internet, le reverse proxy fonctionne dans l'autre sens : il reçoit les requêtes provenant d'internet et les transmet aux serveurs internes appropriés.

Exemple : Imaginons une entreprise qui héberge plusieurs applications web. Sans reverse proxy, chaque application nécessiterait sa propre adresse IP publique et son propre certificat SSL. Avec un reverse proxy, une seule adresse IP publique suffit : le proxy analyse chaque requête entrante et la redirige intelligemment vers le bon serveur backend en fonction de critères comme l'URL demandée, le type de contenu ou la charge des serveurs.

Cette architecture apporte plusieurs avantages fondamentaux :

Il masque l'architecture interne du système d'information, rendant les serveurs backend invisibles depuis l'extérieur

Il centralise la gestion de la sécurité en créant un point de contrôle unique pour filtrer le trafic malveillant

Il permet de répartir la charge entre plusieurs serveurs pour garantir des performances optimales même lors de pics d'activité

Nginx, le leader du marché ?

Créé en 2002 par l'ingénieur russe Igor Sysoev, Nginx (prononcé "engine-x") a été conçu pour résoudre un problème précis : gérer des dizaines de milliers de connexions simultanées sans consommer trop de ressources système. Son architecture révolutionnaire, basée sur un modèle événementiel asynchrone, contraste fortement avec les serveurs web traditionnels comme Apache qui créent un processus distinct pour chaque connexion.

Cette différence technique se traduit par des performances exceptionnelles. Là où Apache peut rapidement saturer la mémoire avec quelques milliers de connexions simultanées, Nginx peut en gérer plusieurs dizaines de milliers avec une empreinte mémoire minimale. Concrètement, Nginx peut servir du contenu statique environ 2,5 fois plus rapidement qu'Apache tout en consommant beaucoup moins de ressources.

Ces performances expliquent pourquoi Nginx équipe aujourd'hui plus de 300 millions de sites web, dont certains des plus grands noms d'internet : Netflix, Dropbox, Airbnb, WordPress.com, GitHub et CloudFlare font tous confiance à cette technologie.

Nginx maintient sa position de leader du marché des serveurs web en 2026 et confirme une progression continue depuis sa création et une domination sur les sites à fort trafic.

Les fonctions clés d'un reverse proxy Nginx

Nginx remplit plusieurs rôles essentiels qui vont bien au-delà du simple service de pages web.

Répartition de charge (Load Balancing)

Lorsqu'une application web connaît un fort trafic, un seul serveur backend ne suffit généralement pas. Nginx distribue automatiquement les requêtes entrantes entre plusieurs serveurs selon différents algorithmes :

Distribution circulaire (round-robin)

Serveur le moins chargé

Session persistante pour maintenir un utilisateur sur le même serveur

Cette répartition évite la saturation d'un serveur unique et garantit la continuité de service même en cas de défaillance d'un backend.

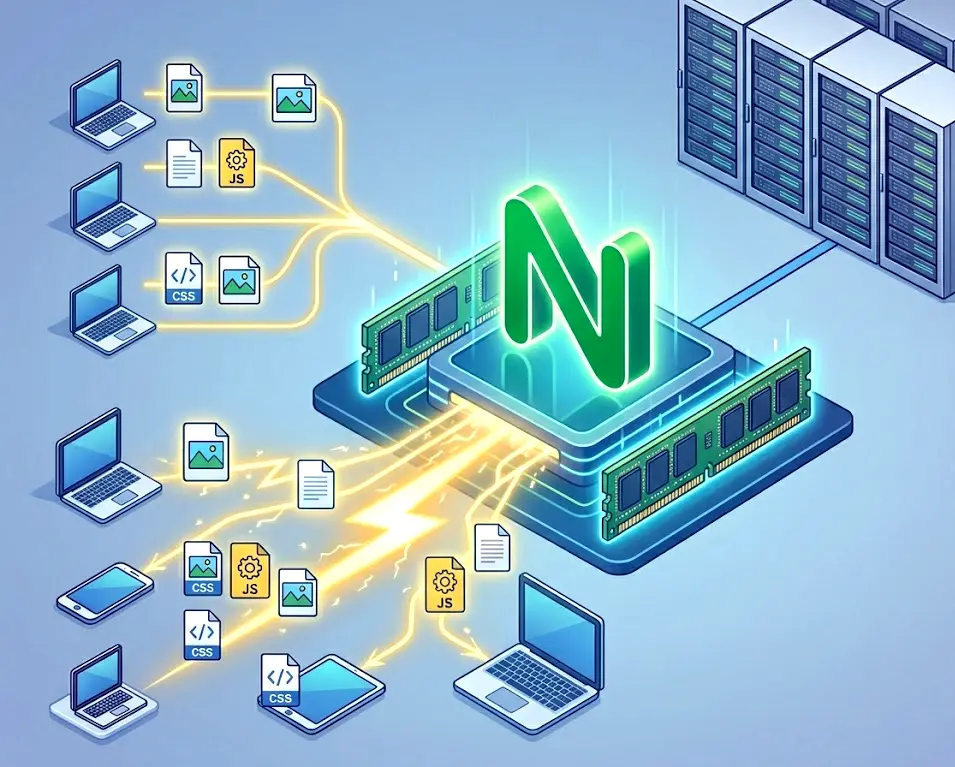

Mise en cache et accélération web

Nginx peut stocker temporairement le contenu statique fréquemment demandé (images, feuilles de style CSS, fichiers JavaScript) dans son cache local.

Plutôt que de solliciter systématiquement les serveurs backend, Nginx sert directement ces ressources depuis sa mémoire.

Il réduit ainsi les temps de réponse et la charge sur l'infrastructure applicative.

Terminaison SSL/TLS

Le chiffrement et le déchiffrement des communications HTTPS nécessitent une puissance de calcul importante. Nginx peut prendre en charge cette tâche en gérant les certificats SSL et en établissant les connexions sécurisées avec les clients. Les communications entre Nginx et les serveurs backend peuvent ensuite se faire en HTTP non chiffré sur le réseau interne.

Cela allège la charge cryptographique des serveurs applicatifs.

Sécurité et protection

En positionnant Nginx en frontal de l'infrastructure, les adresses IP des serveurs backend restent invisibles depuis l'extérieur. Cette couche supplémentaire complique considérablement les attaques ciblées.

Nginx peut également implémenter des mécanismes de protection comme la limitation du débit de requêtes (rate limiting) pour bloquer les tentatives d'attaques DDoS, ou filtrer les requêtes malformées avant qu'elles n'atteignent les applications.

Nginx dans les architectures cloud de confiance

Les infrastructures cloud sécurisées, particulièrement celles destinées aux données sensibles, reposent sur des architectures multicouches où la sécurité s'applique à chaque niveau. Dans ce contexte, Nginx joue un rôle stratégique de point d'entrée et de contrôle.

Une infrastructure cloud de confiance typique utilise Nginx comme premier niveau de défense. Toutes les requêtes externes transitent d'abord par le reverse proxy qui effectue des vérifications de sécurité : validation des certificats clients, vérification des en-têtes HTTP, filtrage géographique si nécessaire. Cette centralisation permet d'appliquer des politiques de sécurité cohérentes sur l'ensemble de l'infrastructure.

Nginx facilite également la mise en œuvre de l'isolation entre environnements. Dans une plateforme multi-tenant où plusieurs clients partagent la même infrastructure, le reverse proxy peut router le trafic de chaque organisation vers des serveurs backend dédiés, garantissant l'étanchéité entre les données de différents clients. Cette séparation logique renforce la confidentialité tout en mutualisant les ressources matérielles.

Pour les organisations soumises à des exigences réglementaires strictes, Nginx permet de tracer précisément les flux entrants :

- quelles requêtes arrivent,

- d'où,

- vers quelles ressources,

- avec quels résultats.

Ces logs détaillés constituent une base essentielle pour les audits de conformité et les investigations en cas d'incident de sécurité.

Configuration et optimisation

La mise en œuvre d'un reverse proxy Nginx nécessite une configuration réfléchie. Les principaux paramètres à ajuster concernent :

- la gestion des buffers (zones mémoire temporaires pour stocker les requêtes et réponses),

- les timeout de connexion,

- les règles de cache.

Les équipes techniques doivent aussi surveiller en permanence les métriques de performance :

- nombre de connexions actives,

- taux de succès du cache,

- latence moyenne,

- consommation mémoire.

Nginx propose une API de statistiques temps réel et s'intègre facilement avec des outils de monitoring comme Prometheus ou Grafana.

Nginx face à la concurrence

Bien que dominant, Nginx n'est pas la seule solution de reverse proxy.

Apache

peut également jouer ce rôle, avec l'avantage d'une compatibilité immédiate avec de nombreuses applications web grâce aux fichiers .htaccess.

Traefik

se distingue par sa configuration automatique dans les environnements conteneurisés Kubernetes.

HAProxy

excelle particulièrement en répartition de charge TCP/UDP.

Caddy

simplifie radicalement la configuration avec l'obtention automatique de certificats SSL.

Le choix entre ces solutions dépend des priorités de l'infrastructure.

Nginx reste le meilleur compromis pour les environnements nécessitant simultanément haute performance, faible consommation de ressources et fonctionnalités avancées.

Sa maturité et son écosystème riche en modules en font une valeur sûre pour les projets critiques.

Tendances et évolutions

L'écosystème Nginx continue d'évoluer pour répondre aux nouveaux défis des infrastructures cloud. L'intégration native avec les plateformes d'orchestration de conteneurs (Kubernetes via Nginx Ingress Controller) simplifie le déploiement dans les architectures cloud-native. Le support natif du protocole QUIC et HTTP/3 améliore les performances pour les applications modernes. L'intégration de capacités d'intelligence artificielle pour l'analyse de trafic et la détection d'anomalies commence à émerger dans les versions entreprise.

Pour les entreprises françaises soucieuses de souveraineté numérique,

Nginx présente l'avantage d'être une solution open source sans dépendance vis-à-vis d'un éditeur étranger unique. Cette indépendance technologique facilite l'obtention de certifications comme SecNumCloud qui imposent des contraintes strictes sur la maîtrise de la chaîne logicielle.